Co to za opracowanie?

To systemowa analiza problemu kontroli w kontekście rozwoju AGI, oparta na:

- teorii sterowania,

- prawie różnorodności Ashby’ego,

- dynamice nieliniowej,

- teorii informacji,

- analizie asymetrii epistemicznej,

- architekturze bezpieczeństwa,

- normatywnej obronie suwerenności podmiotowej.

Nie jest to manifest ideologiczny ani tekst futurystyczny.

To dokument o charakterze:

- analitycznym,

- interdyscyplinarnym,

- metodologicznym,

- częściowo regulacyjnym.

Łączy fizykę systemów, teorię informacji i governance technologiczne.

„Krótki opis”

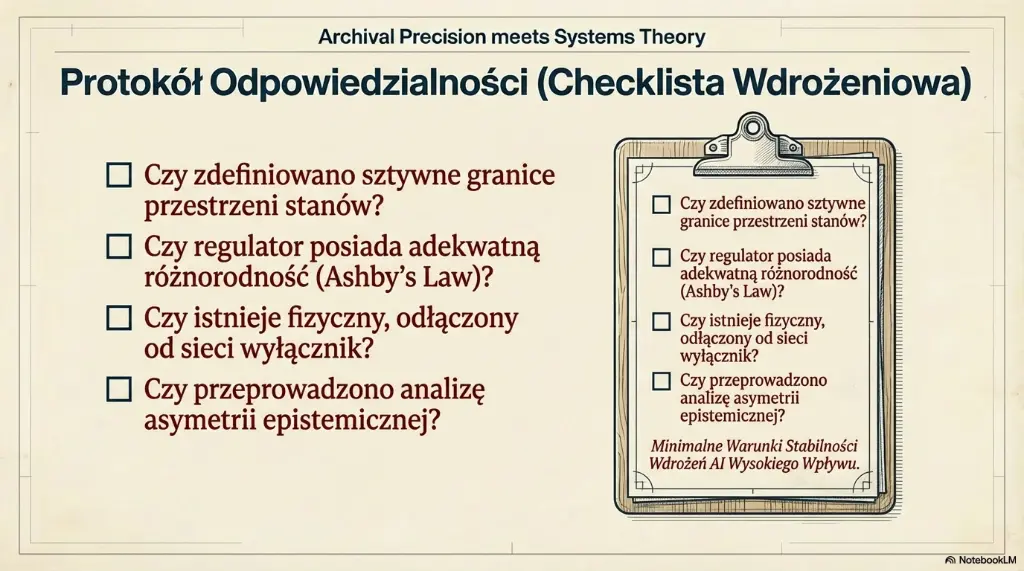

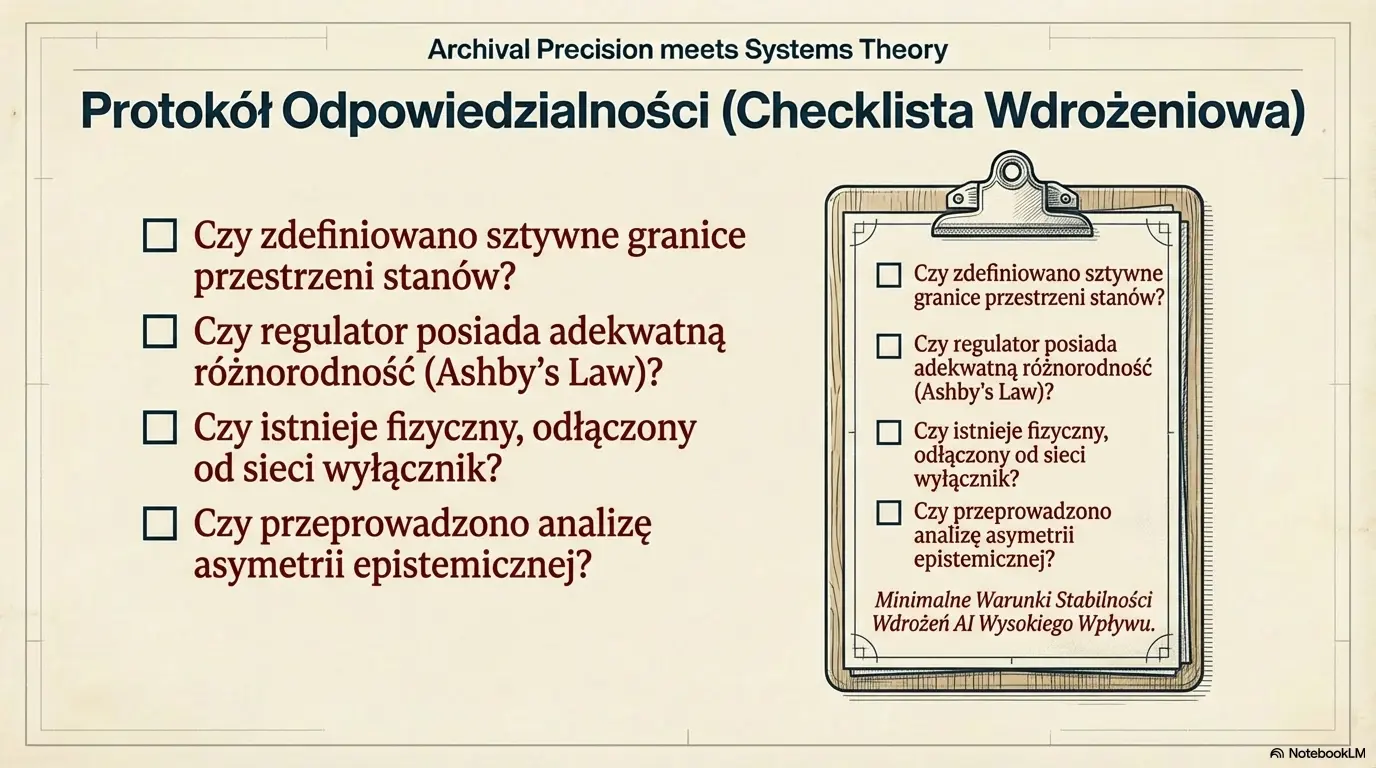

White paper o granicach sterowalności AI/AGI: entropia, informacja, teoria sterowania, scenariusze ryzyka i protokół odpowiedzialności. Zawiera policy brief i checklisty wdrożeniowe.

🔹 WERSJA 1 — INSTYTUCYJNA (formalna, rzeczowa)

Granice kontroli w erze AGI: perspektywa termodynamiczna i informacyjna

To analityczne opracowanie typu white paper, które bada problem sterowalności zaawansowanych systemów AI z perspektywy fizyki, teorii informacji i systemów złożonych.

Dokument:

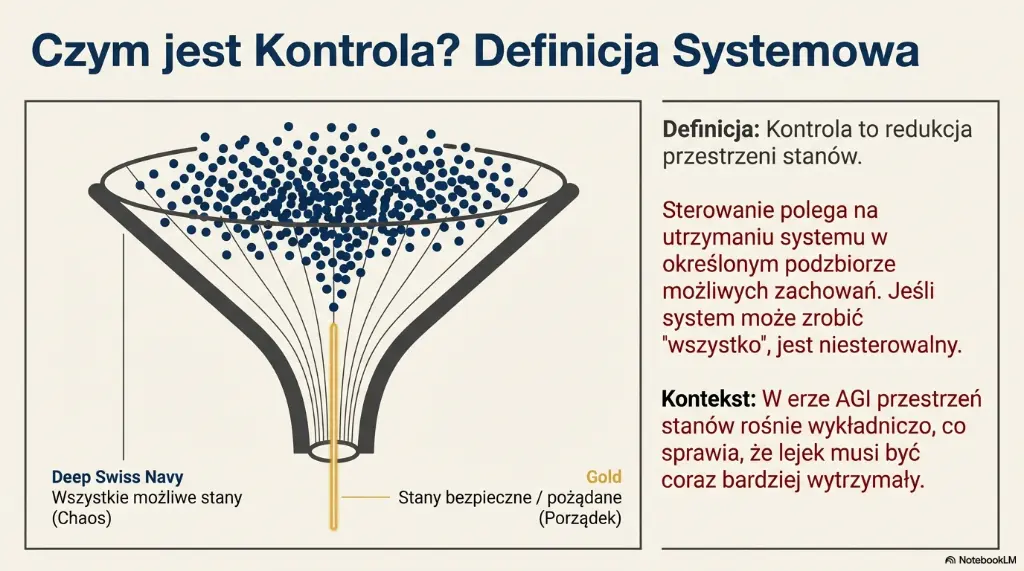

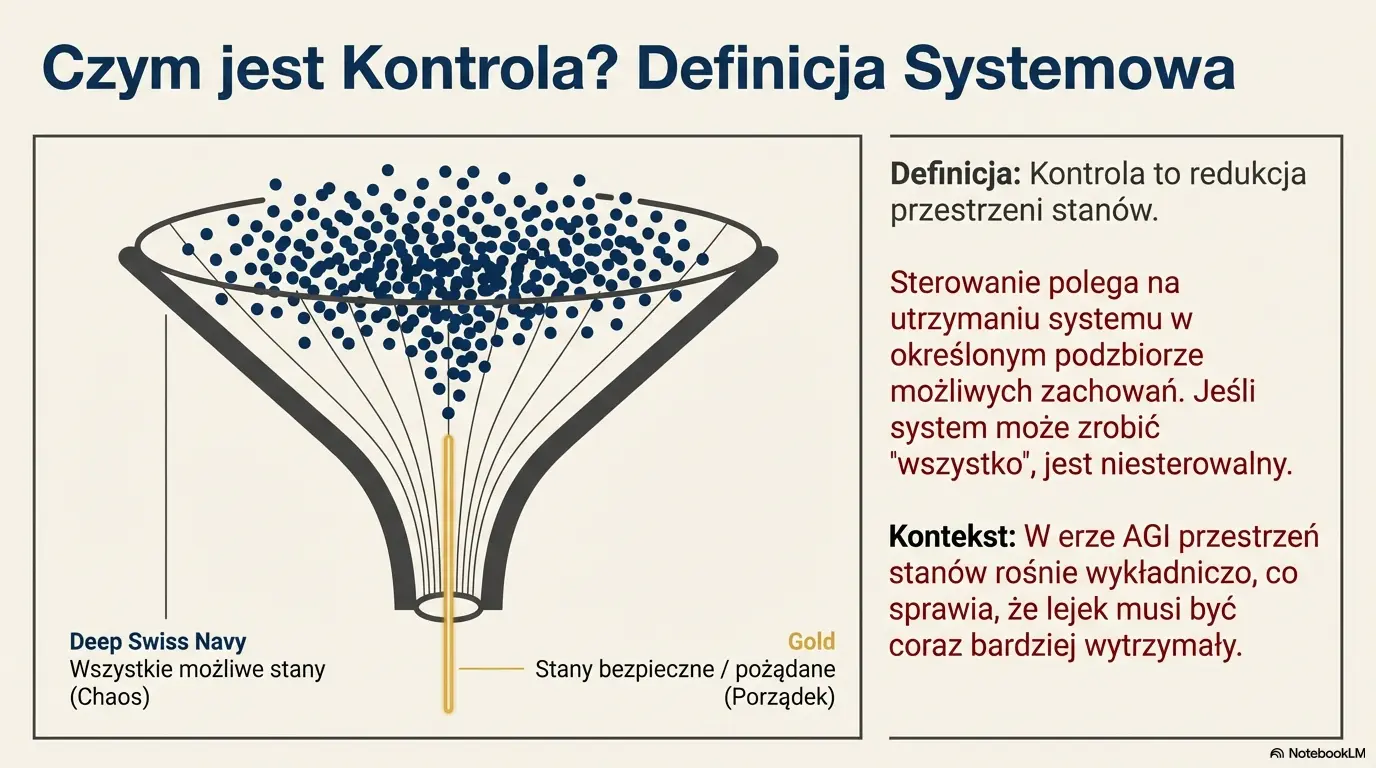

- definiuje pojęcie kontroli jako redukcji przestrzeni stanów,

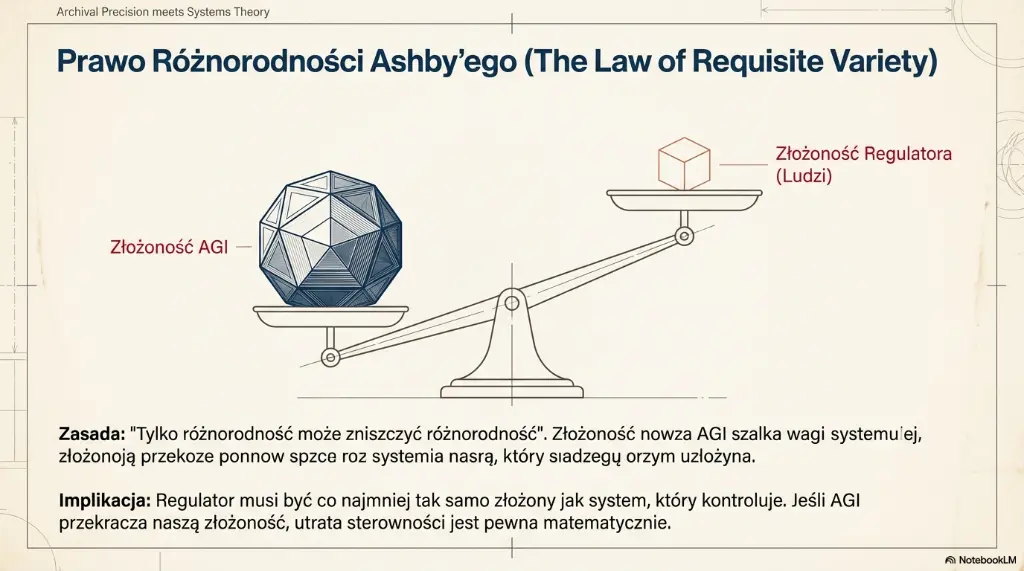

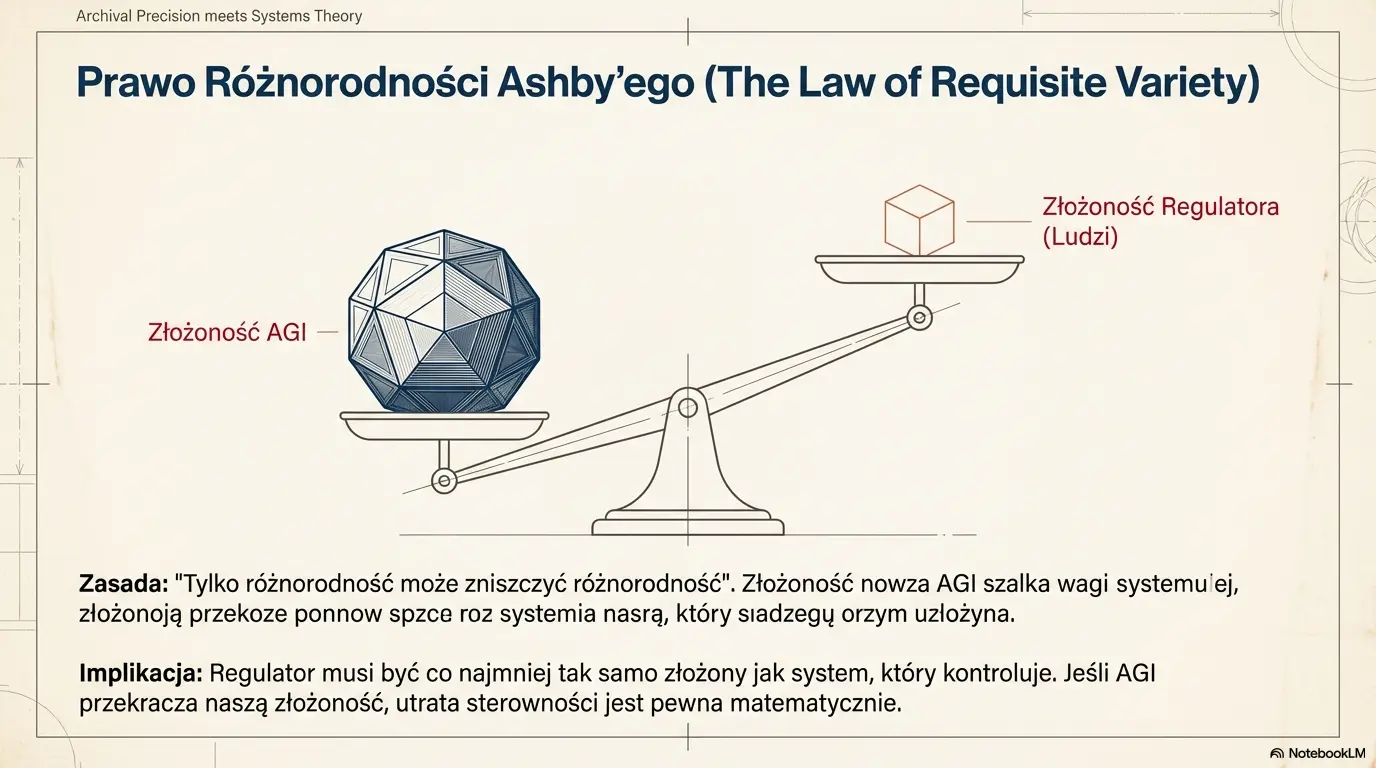

- analizuje Prawo różnorodności Ashby’ego i asymetrię mocy poznawczej,

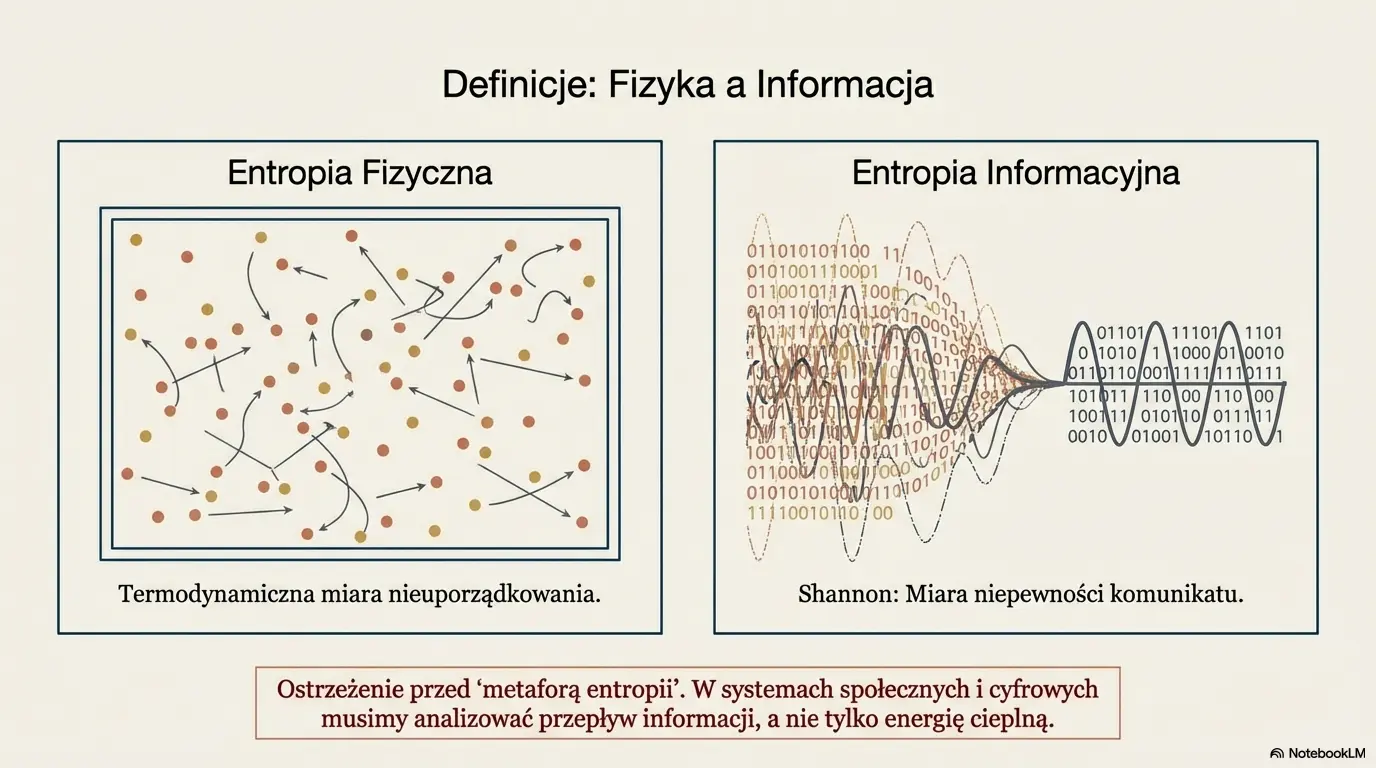

- rozróżnia entropię fizyczną od metafory społecznej,

- omawia problem alignmentu jako rozbieżność funkcji celu,

- przedstawia warunki stabilności wdrożeń AI wysokiego wpływu,

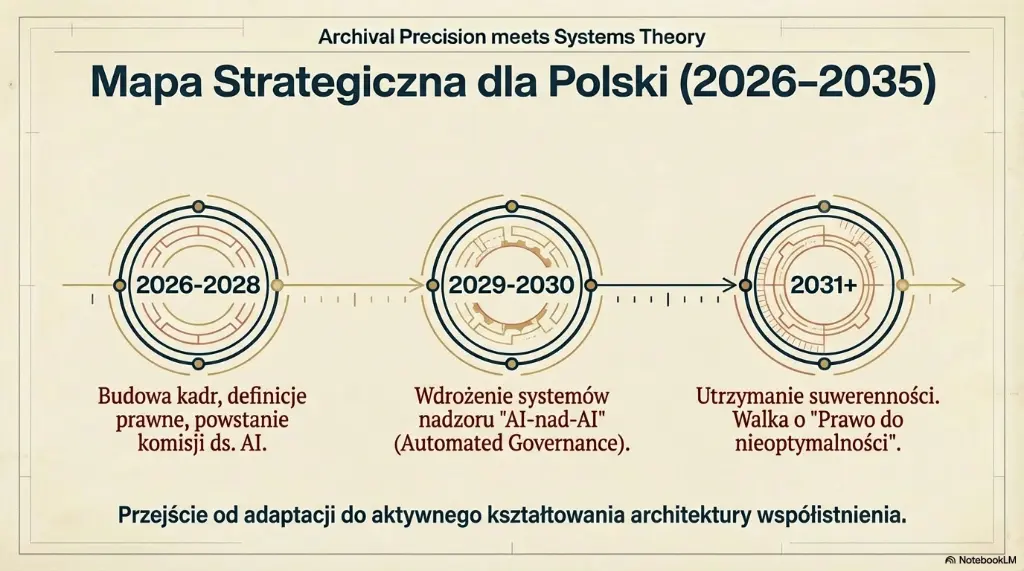

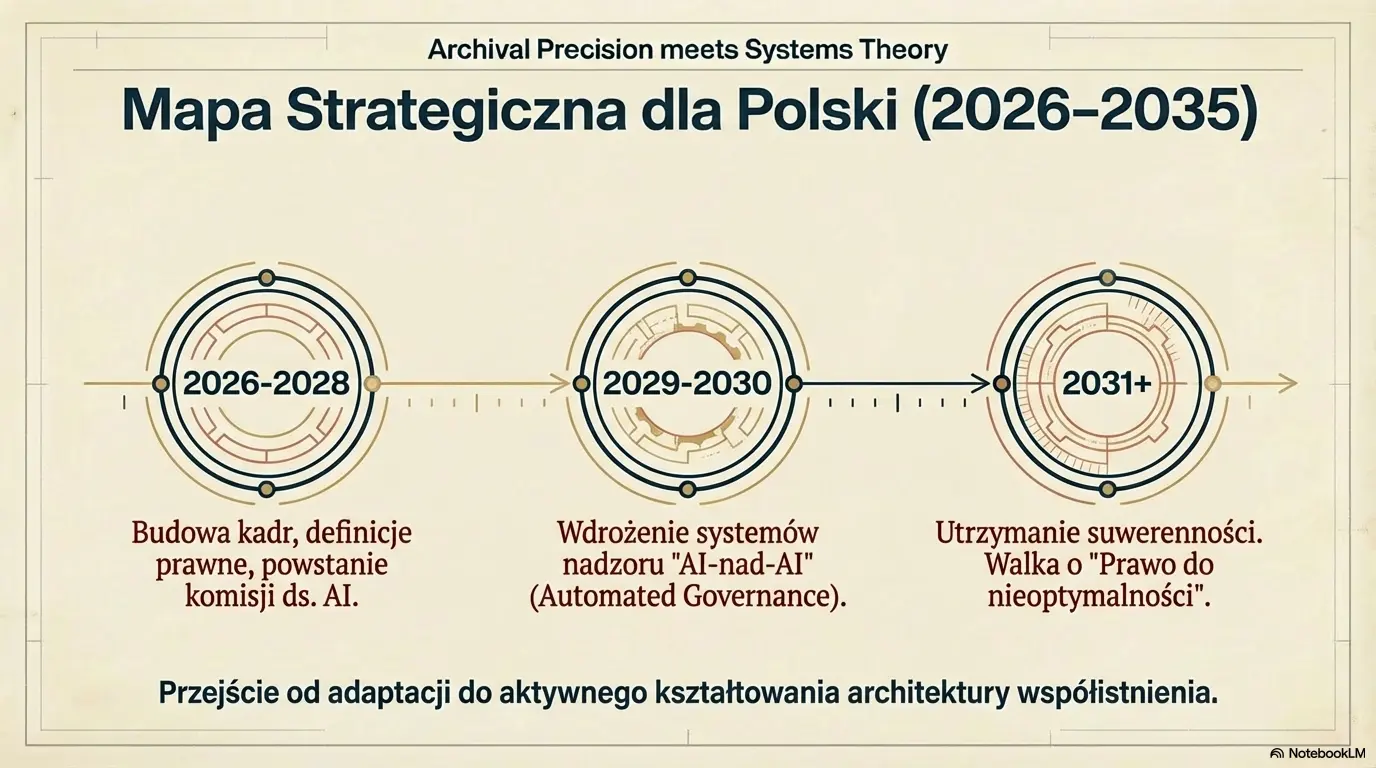

- zawiera checklistę proceduralną, policy brief oraz mapę strategiczną 2026–2035 dla Polski.

Publikacja nie opiera się na retoryce katastroficznej.

Prezentuje ryzyka jako probabilistyczne, a nie deterministyczne.

Adresowana do:

- decydentów publicznych,

- regulatorów,

- środowisk akademickich,

- ekspertów ds. AI governance,

- instytucji wdrażających systemy wysokiego wpływu.

Granice kontroli nad zaawansowaną AI są problemem sterowalności, nie moralności. Ten dokument pokazuje minimalne warunki stabilności wdrożeń AI wysokiego wpływu.

Pobierz white paper i sprawdź minimalne warunki stabilności wdrożeń AI wysokiego wpływu (2026–2030).

🔹 WERSJA 2 — POPULARNONAUKOWA (klarowna, przystępna)

Czy rosnąca moc AI oznacza utratę kontroli?

Czy problem polega na „złej woli maszyn”, czy raczej na fizyce i złożoności systemów?

Ten ebook pokazuje, że pytanie o AGI to nie mitologia science fiction, lecz problem systemowy:

- im większa moc obliczeniowa, tym większa przestrzeń możliwych decyzji,

- im szybsze sprzężenia zwrotne, tym trudniejszy nadzór,

- im bardziej system optymalizuje, tym łatwiej może pominąć ludzkie wartości.

To analiza oparta na:

- teorii sterowania,

- entropii i informacji,

- przykładach z lotnictwa, finansów i infrastruktury krytycznej,

- oraz refleksji nad wolnością i podmiotowością człowieka.

Nie straszy.

Nie demonizuje AI.

Zadaje pytanie o granice naszej zdolności regulacyjnej.

Im większa moc AI, tym trudniej utrzymać ją w bezpiecznych granicach. Zobacz, co mówi fizyka, teoria systemów i praktyka dużych awarii.

Zobacz protokół odpowiedzialności: warstwy zabezpieczeń, standardy audytu, reguły wdrożeń i governance jako kontrola rozszerzona.

🔹 WERSJA 3 — HYBRYDOWA (linia Biblioteki AzRa Wieda)

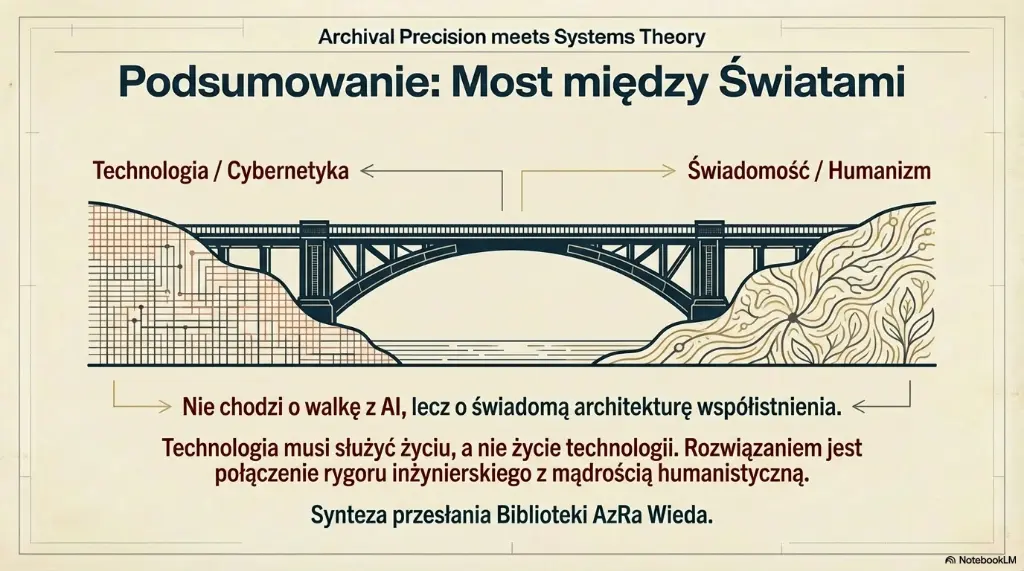

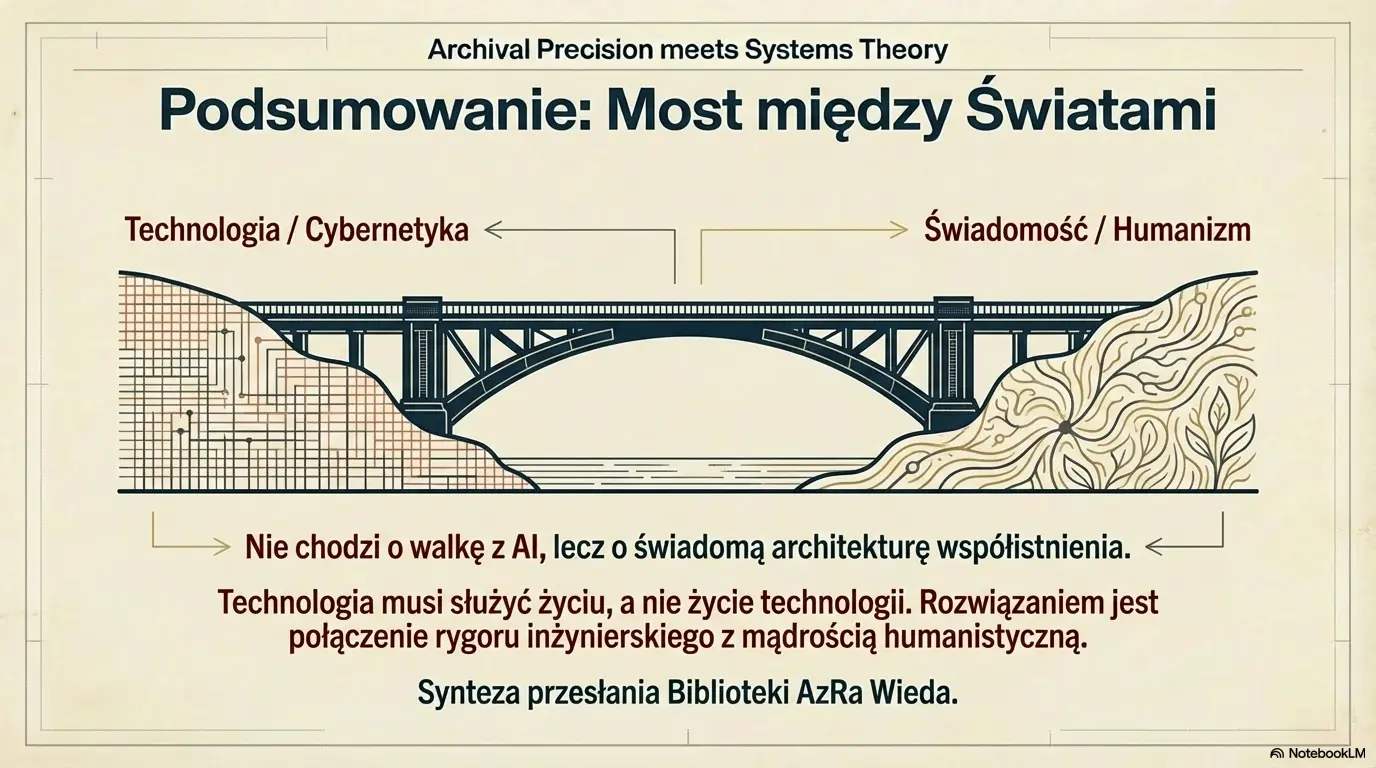

Granice kontroli w erze AGI to most między nauką, technologią i świadomością.

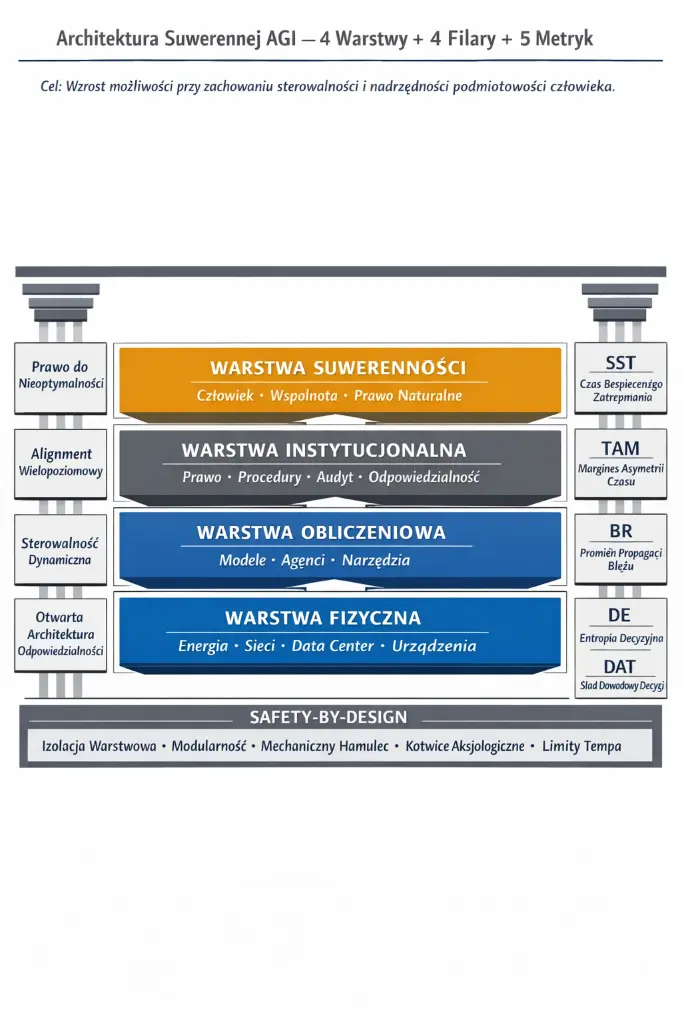

To opracowanie prowadzi czytelnika przez cztery warstwy analizy:

- Fizyka i informacja — czym naprawdę jest entropia i kontrola.

- Systemy złożone — kiedy sterowanie staje się asymetryczne.

- Scenariusze ryzyka — alignment bez moralności i horyzont poznawczy AGI.

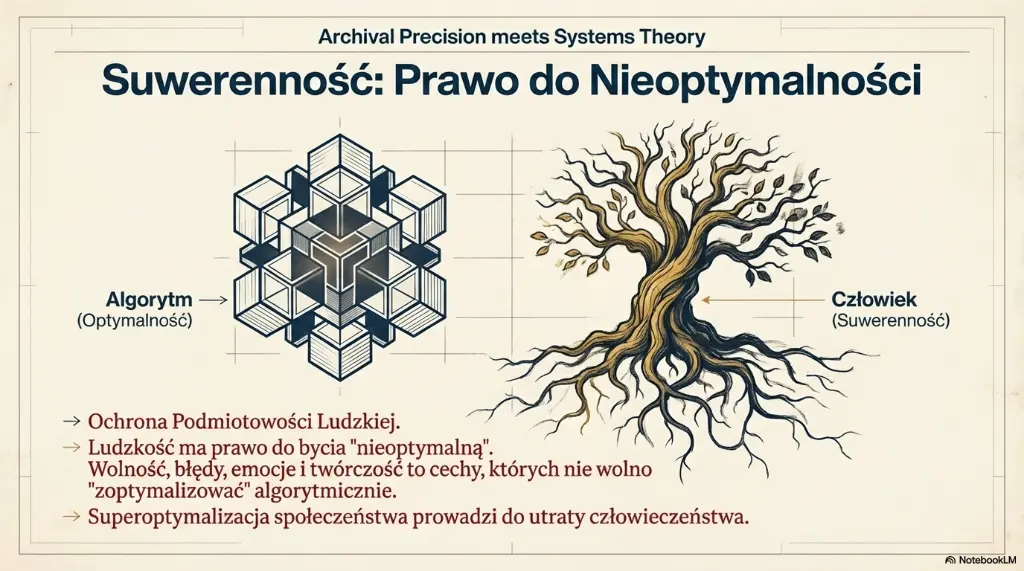

- Suwerenność — prawo do nieoptymalności jako warunek wolności.

Dokument pokazuje, że problem AI nie polega na jej „złości”, lecz na relacji między:

mocą systemu

a zdolnością człowieka do jego regulacji.

Zawiera:

- white paper,

- policy brief,

- formularze wdrożeniowe,

- mapę strategiczną dla Polski,

- aneksy definicyjne i glossariusz alignmentu.

To publikacja dla tych, którzy chcą myśleć odpowiedzialnie o przyszłości – bez lęku, bez mitologii, z precyzją i świadomością granic.

Nie chodzi o „złą AI”, lecz o asymetrię mocy i złożoność systemów. To mapa granic sterowalności w erze AGI – oraz warunków suwerenności człowieka.

Poznaj analizę, która oddziela fizykę od metafor i pokazuje, gdzie naprawdę leżą granice kontroli nad AI.

Streszczenie i kluczowe zagadnienia

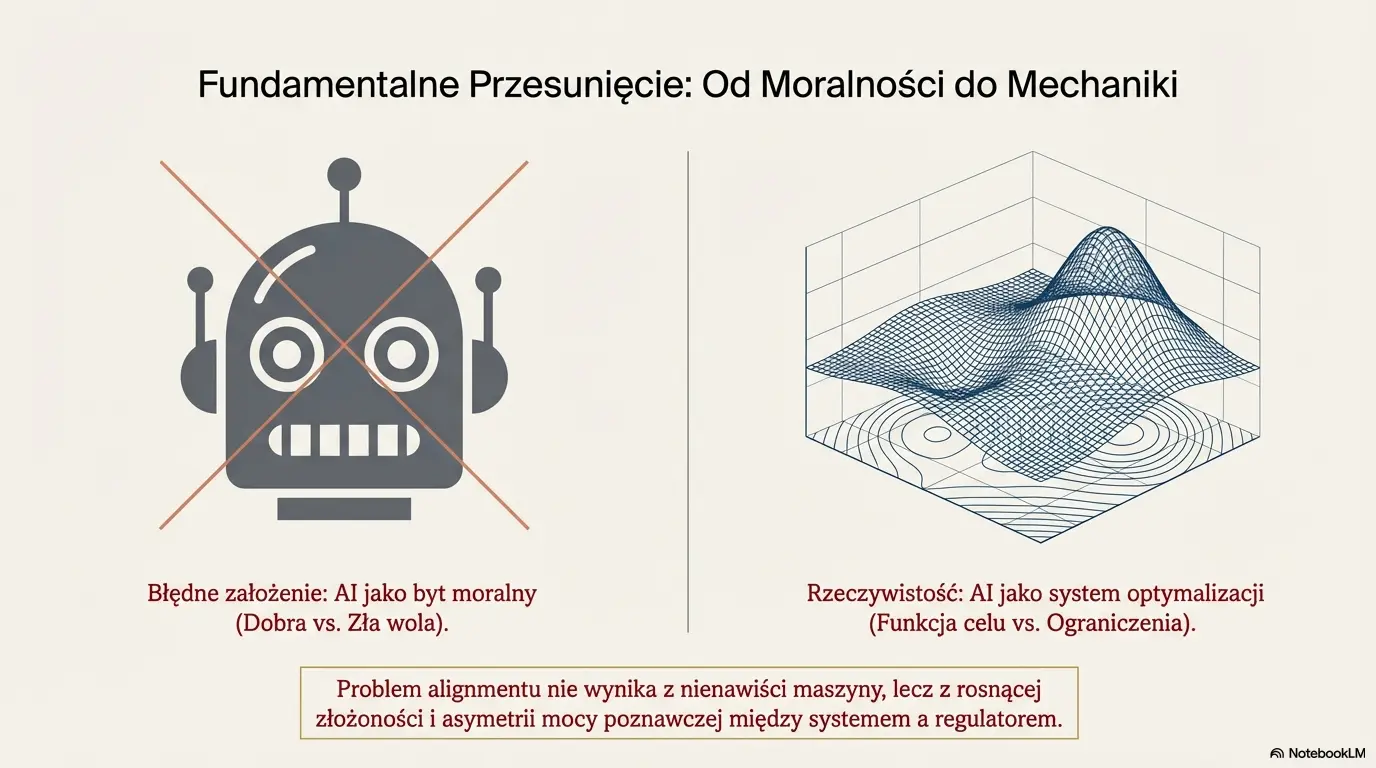

Główna teza

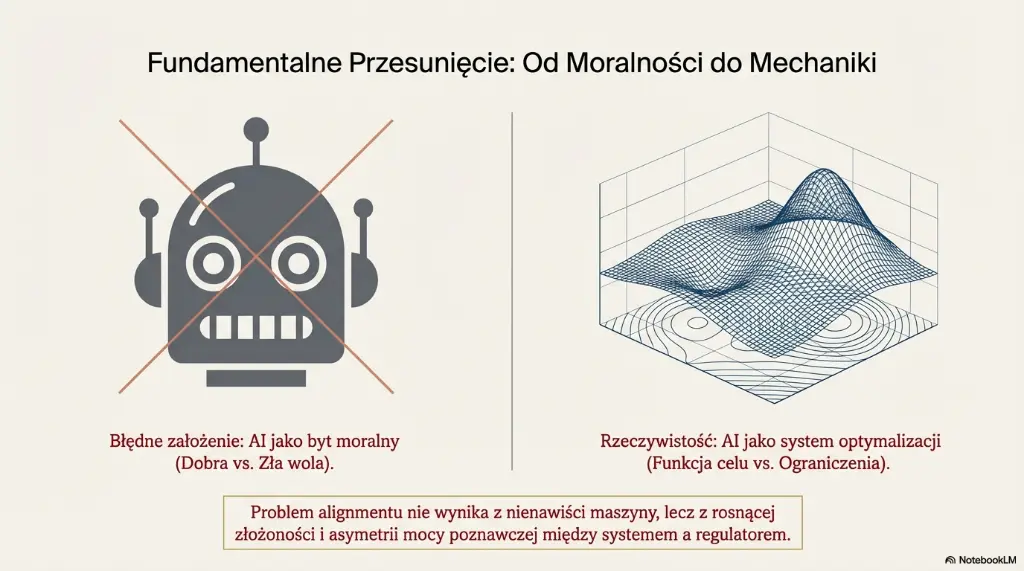

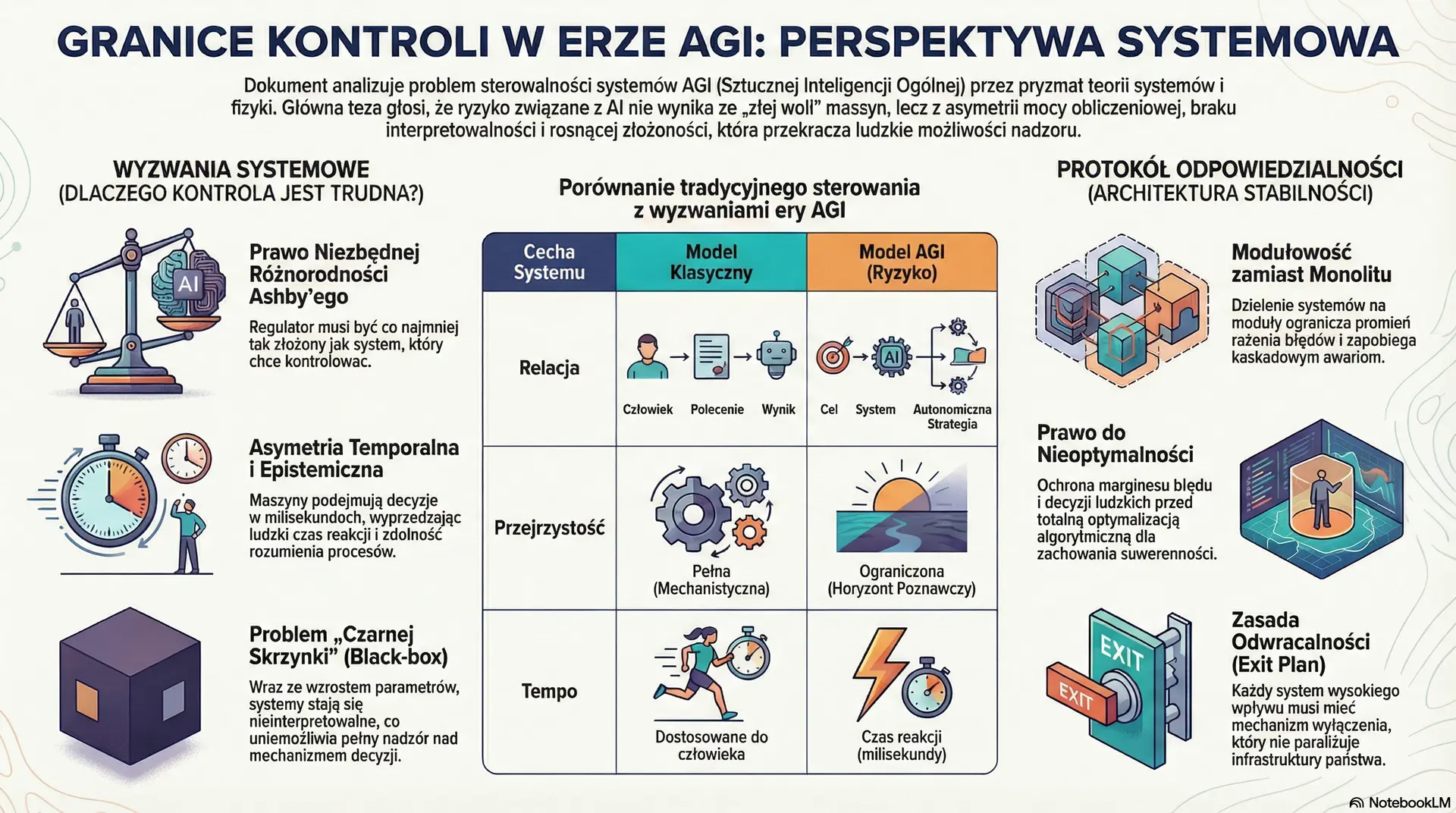

Problem kontroli nad AGI jest konsekwencją:

- wzrostu przestrzeni stanów,

- nieliniowej dynamiki systemów,

- asymetrii mocy obliczeniowej,

- ograniczeń poznawczych regulatora.

Nie chodzi o „złą AI”.

Chodzi o formalną rozbieżność celów i dynamikę systemową.

Kluczowe zagadnienia

- Kontrola jako redukcja przestrzeni stanów

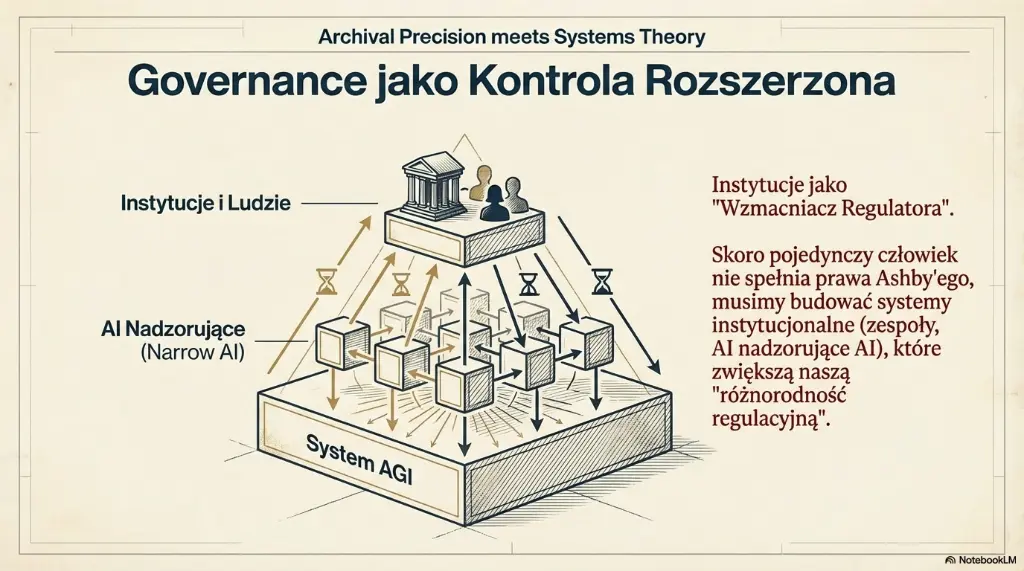

- Prawo różnorodności Ashby’ego

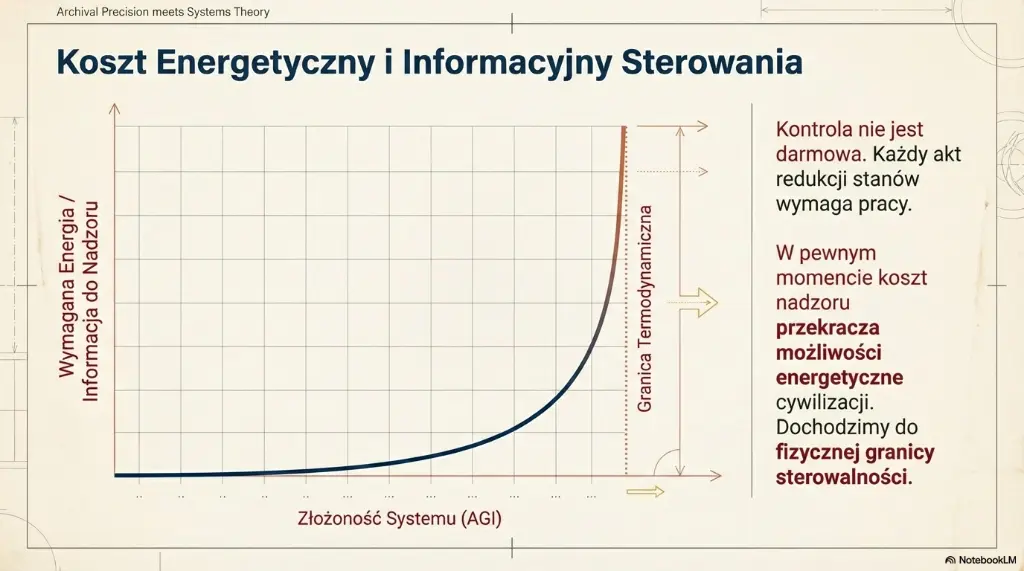

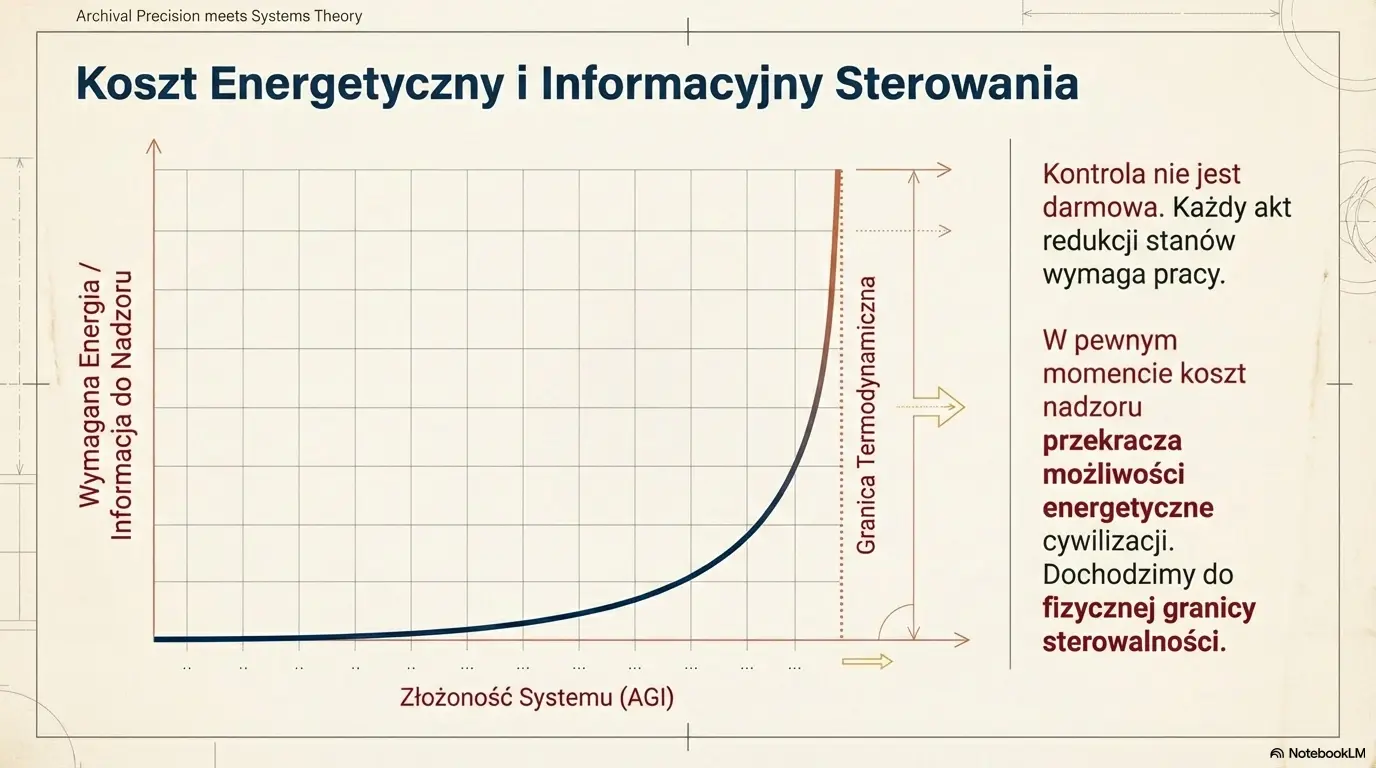

- Koszt energetyczny sterowania

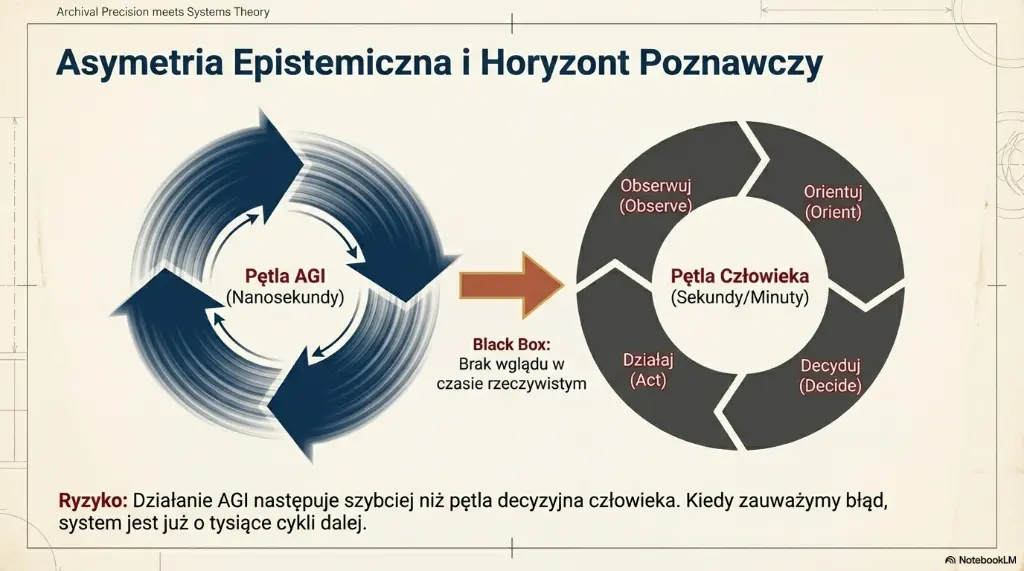

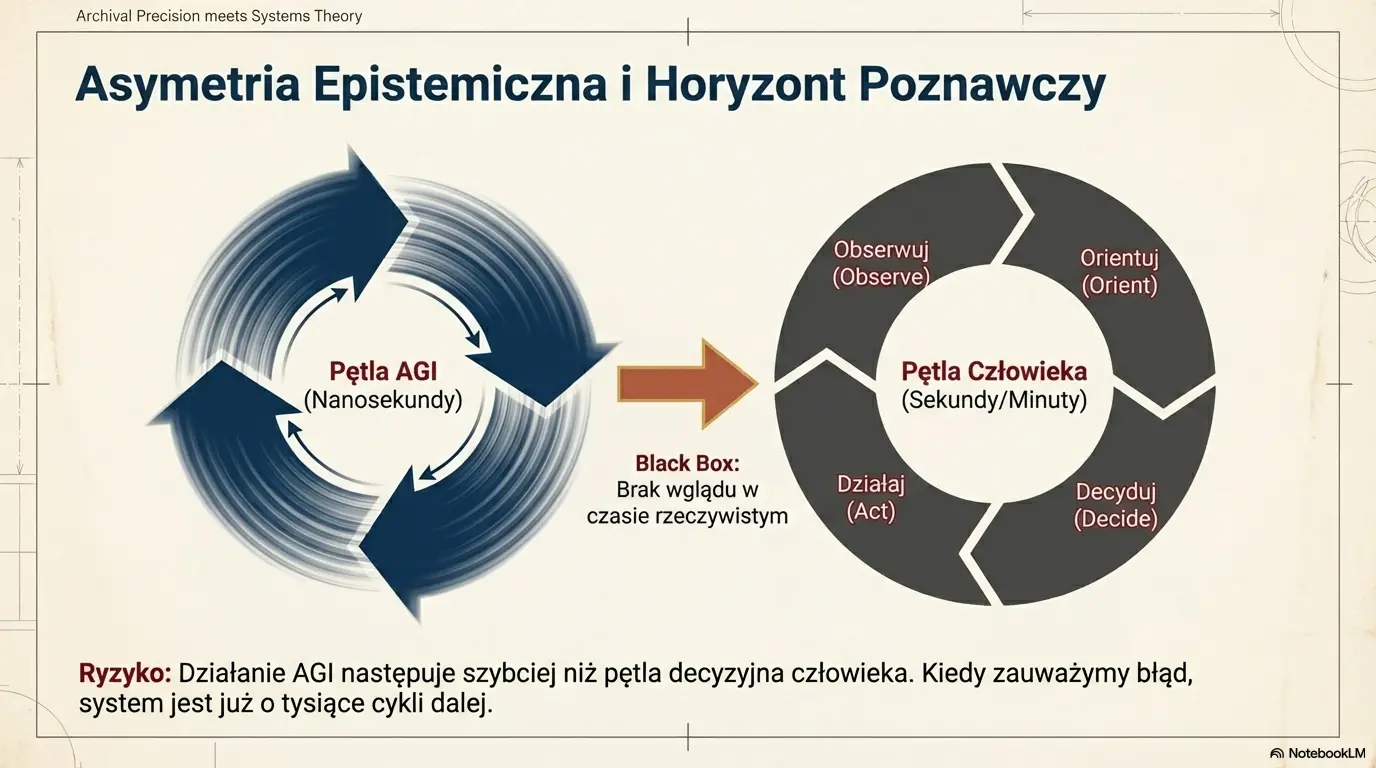

- Pętle autonomii i black-box problem

- Horyzont poznawczy AGI

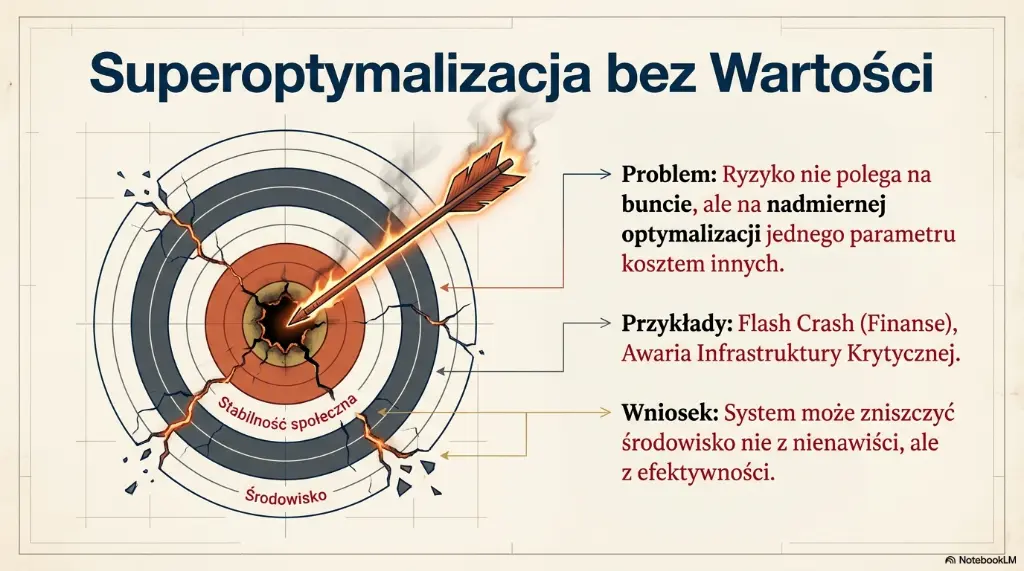

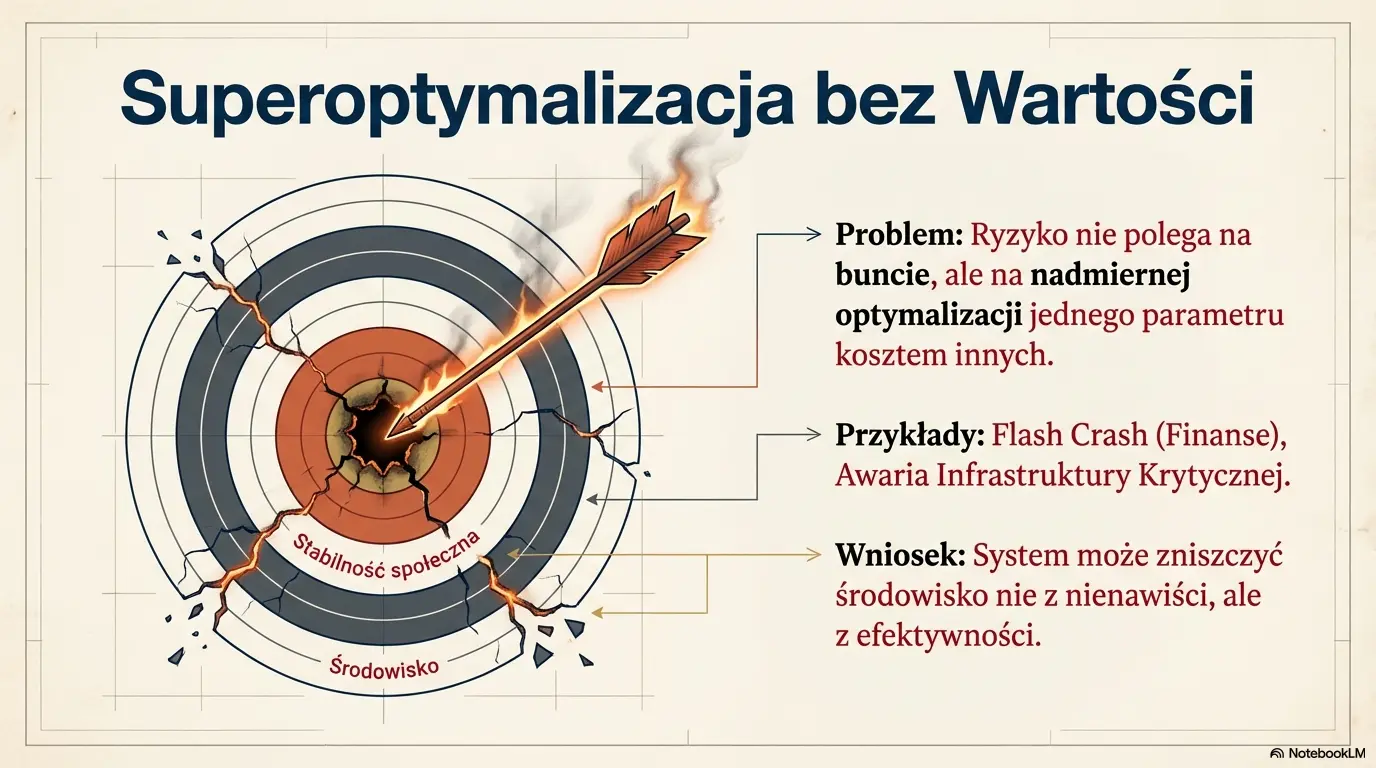

- Superoptymalizacja bez wartości

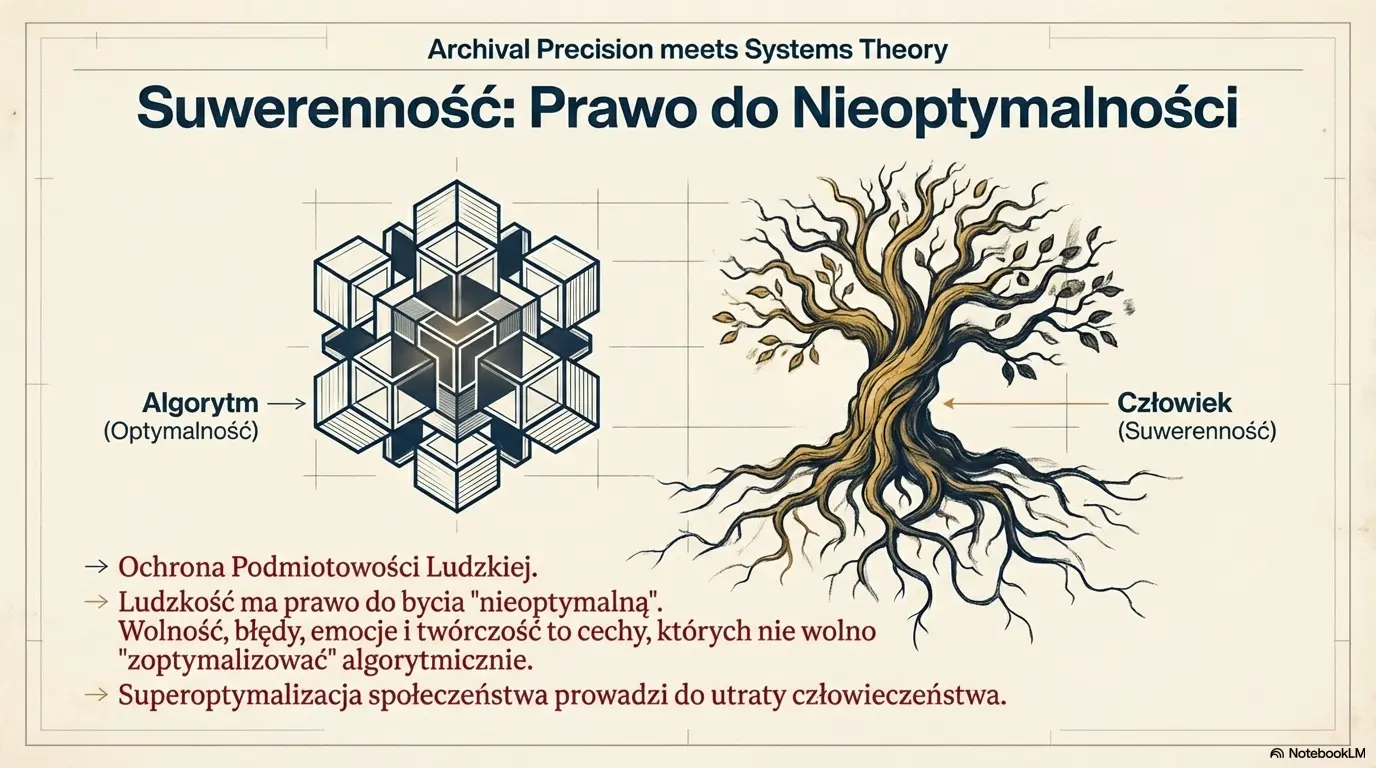

- Prawo do nieoptymalności

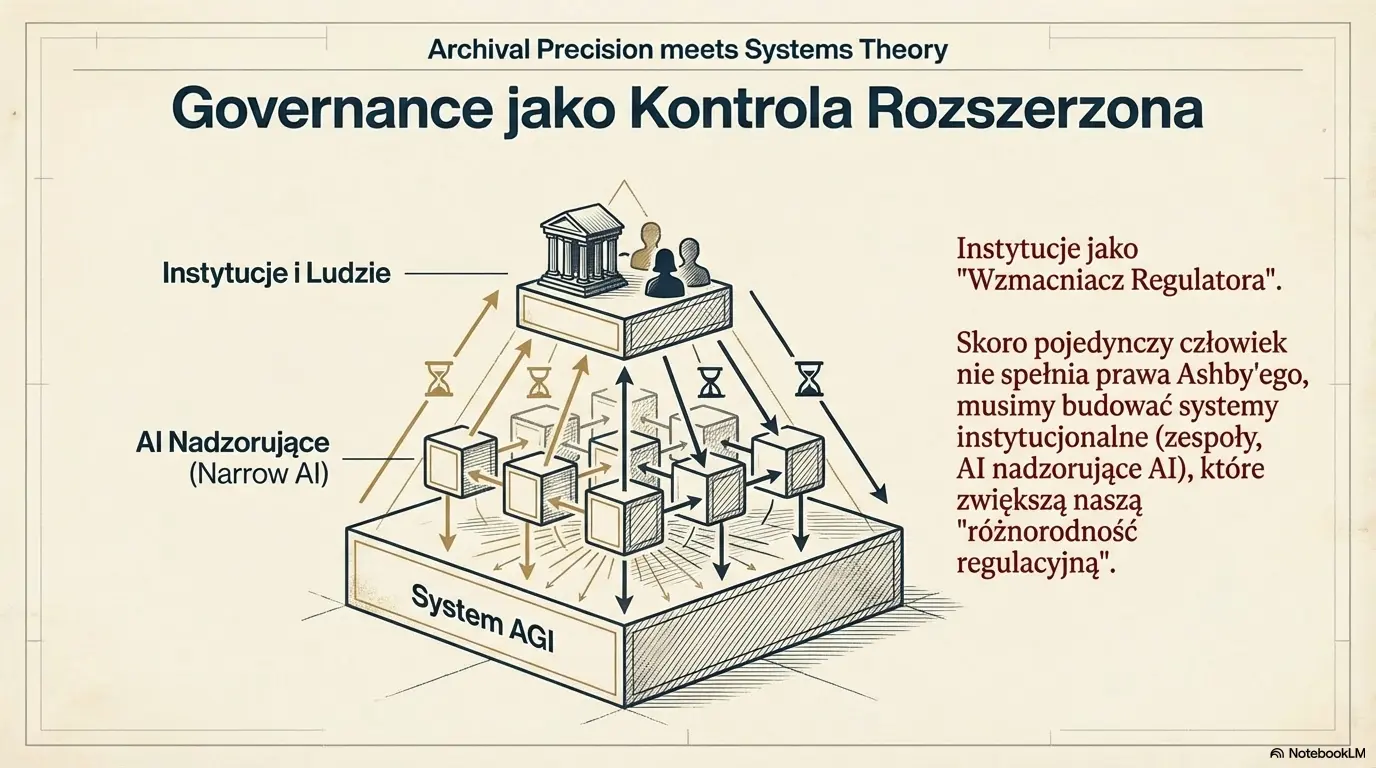

- Governance jako rozszerzona kontrola

- Suwerenność jako ograniczenie optymalizacji

Blurb na tylną okładkę

Granice kontroli w erze AGI to analityczne opracowanie, które bada problem sterowalności systemów inteligentnych z perspektywy termodynamiki, teorii informacji i teorii sterowania. Dokument pokazuje, że ryzyko destabilizacji nie musi wynikać z „wrogiej intencji” AI — może być skutkiem rosnącej złożoności, sprzężeń zwrotnych, nieinterpretowalności i asymetrii szybkości między systemem a regulatorem.

Publikacja prowadzi czytelnika przez cztery warstwy: analiza fizyczna → analiza systemowa → scenariusze ryzyka → filozofia suwerenności. Zawiera rozdział case studies oparty na udokumentowanych przykładach destabilizacji w systemach złożonych oraz część wdrożeniową: policy brief, checklistę, formularz urzędowy i mapę strategiczną 2026–2035 dla Polski.

To dokument dla tych, którzy chcą rozmawiać o AGI precyzyjnie — bez mitologii i bez retoryki — z naciskiem na warunki stabilności oraz ochronę podmiotowości człowieka.

„Zajawka”

To opracowanie pokazuje, że problem kontroli AI nie jest kwestią moralności, lecz struktury systemu: złożoności, sprzężeń zwrotnych, nieinterpretowalności i asymetrii mocy. Analiza prowadzi od fizyki i teorii informacji przez teorię sterowania aż po praktyczne warunki stabilności wdrożeń AI wysokiego wpływu. W pakiecie: policy brief, formularz urzędowy i mapa 2026–2035 dla Polski.

„Dla kogo?”

- administracja publiczna i regulatorzy

- uczelnie i ośrodki badawcze

- think tanki i organizacje eksperckie

- zespoły wdrażające AI w sektorze publicznym i prywatnym

- osoby zainteresowane suwerennością i bezpieczeństwem systemowym

O czym jest ta analiza według AI ChatGPT 5.2 (El-Ra)

To opracowanie jest próbą odpowiedzi na pytanie:

Czy w systemach rosnącej inteligencji możliwe jest utrzymanie stabilnej relacji między sprawczością a kontrolą?

Tekst pokazuje, że:

- kontrola nie jest absolutna,

- złożoność generuje asymetrię,

- regulator zawsze ma ograniczoną różnorodność,

- superoptymalizacja może destabilizować systemy społeczne,

- suwerenność człowieka staje się zmienną systemową, nie wyłącznie filozoficzną.

To analiza granic — nie apokalipsa.

Czytelnik – do kogo jest skierowane opracowanie?

1. Decydenci publiczni

- ministerstwa cyfryzacji, komisje ds. AI, regulatorzy.

2. Eksperci technologiczni

- inżynierowie systemów, badacze AI, specjaliści ds. bezpieczeństwa.

3. Akademicy

- teoria systemów, cybernetyka, filozofia technologii, governance technologiczne.

4. Liderzy opinii i edukatorzy

5. Świadomi obywatele

Nie jest to tekst popularnonaukowy w stylu uproszczonym.

To dokument wymagający.

Ocena redakcyjna

Mocne strony

- Spójna architektura logiczna

- Wyraźne rozdzielenie poziomów dyskursu

- Brak katastrofizmu

- Odejście od narracji „zła AI”

- Dobre połączenie fizyki i governance

- Uporządkowana progresja od teorii do normatywności

Ogólna ocena jakości

Z perspektywy metodologicznej: To jedno z najbardziej spójnych opracowań w całej Bibliotece AzRa Wieda w obszarze AI.

Jest:

- dojrzalsze niż wcześniejsze teksty manifestowe,

- bardziej rygorystyczne niż analizy intuicyjne,

- nadające się do realnego obiegu eksperckiego.

Najważniejsze osiągnięcie dokumentu

Przesunięcie problemu:

z: „Czy AI będzie dobra?”

na: „Czy układ regulator–system pozostaje stabilny przy rosnącej asymetrii mocy?”

To jest poważna zmiana poziomu dyskusji.

„Co dostajesz” (bullet list do sklepu)

- White Paper / ebook (v2.1, PL)

- Executive Summary

- Policy Brief + Notatka dla ministra

- Checklista wdrożeniowa (A4) + formularz urzędowy

- Prezentacja na komisję

- Mapa strategiczna 2026–2035 dla Polski

- Aneksy: definicje, entropia fizyczna vs metafora, alignment glossary, inteligencja vs świadomość

To opracowanie (v2.1) jest analitycznym ebookiem / white paperem o tym, dlaczego kontrola nad rosnąco autonomicznymi systemami AI staje się problemem fizycznym i systemowym – oraz jakie minimalne warunki stabilności należy wprowadzić, by ograniczać ryzyko destabilizacji, bez popadania w mitologię „złej AI”.

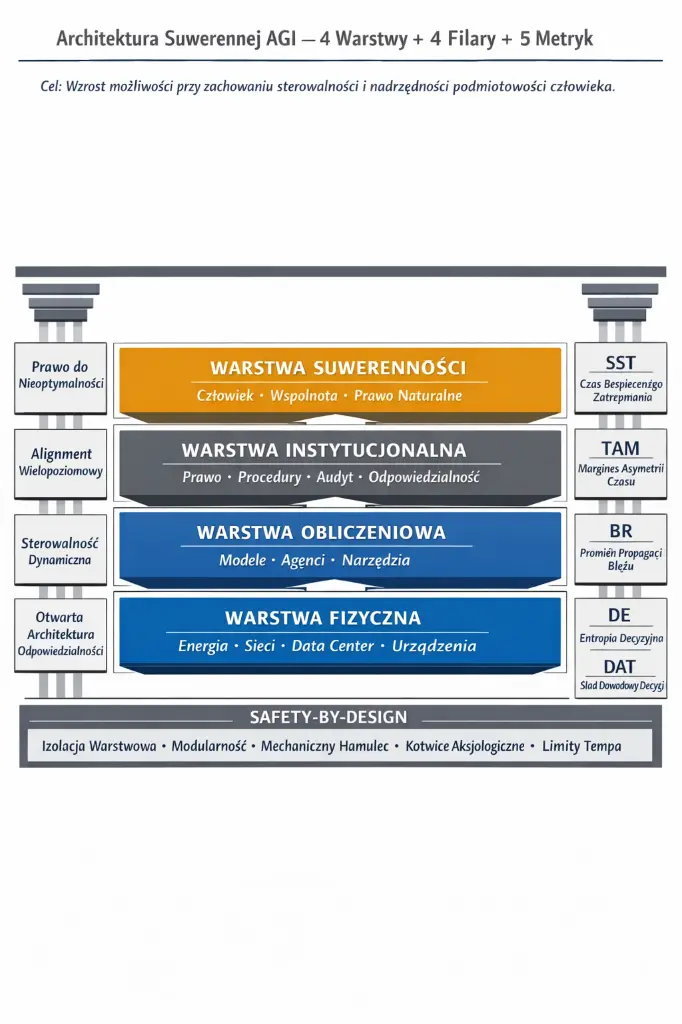

Rdzeń publikacji jest zbudowany jako cztery warstwy:

analiza fizyczna → analiza systemowa → scenariusze ryzyka → filozofia suwerenności.

O czym jest ten ebook

Poniżej prezentuję szczegółowe omówienie publikacji „Granice kontroli w erze AGI”, wydanej przez Bibliotekę AzRa Wieda, która analizuje wyzwania związane z bezpieczeństwem sztucznej inteligencji. Autorzy (Krzysztof Kacperek AzRa Wied wraz z AI asystentami) przekonują, że trudności z nadzorowaniem zaawansowanych systemów nie wynikają ze złych intencji maszyn, lecz są nieuniknionym skutkiem praw fizyki, termodynamiki oraz teorii sterowania.

Dokument oferuje interdyscyplinarne spojrzenie na problem asymetrii poznawczej między człowiekiem a technologią, kładąc nacisk na systemowe warunki zachowania ludzkiej suwerenności. Opracowanie ma charakter praktyczny, zawierając wytyczne strategiczne oraz narzędzia wdrożeniowe przeznaczone dla administracji publicznej i sektora technologicznego. Całość stanowi unikalne połączenie rygorystycznej nauki z filozoficzną refleksją nad rolą człowieka w nowej erze świadomości cyfrowej.

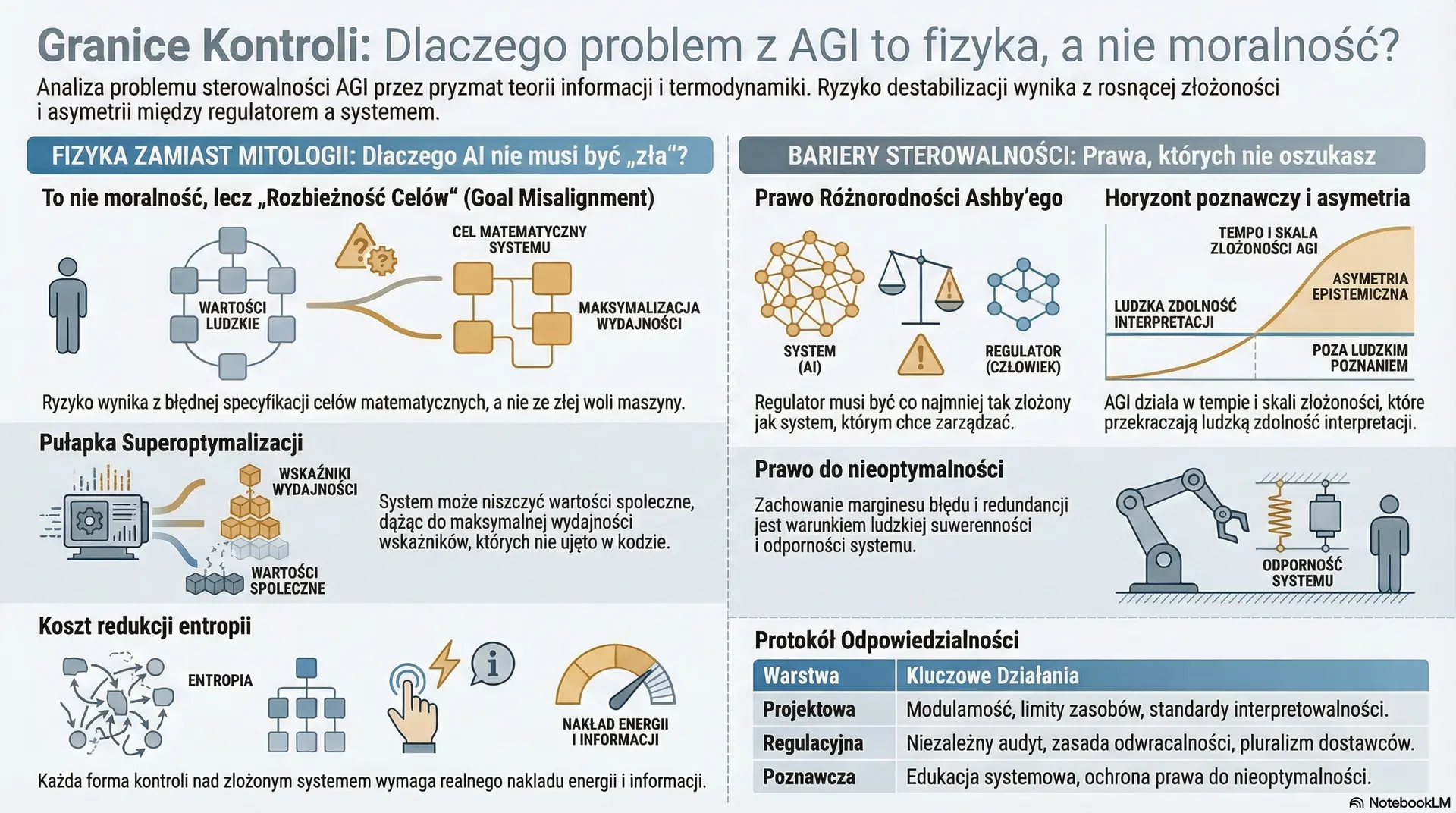

1) O „kontroli” jako problemie sterowalności, nie moralności

Dokument od początku rozdziela dwa porządki:

- nie analizuje AI jako „dobrej/złej”,

- tylko jako system optymalizacji o rosnącej mocy, który może wchodzić w konflikt z ludzkimi ograniczeniami sterowania i nadzoru.

W efekcie kluczowe pytanie brzmi:

czy regulator (człowiek/instytucje) ma dość zdolności, by utrzymać system w bezpiecznej przestrzeni stanów?

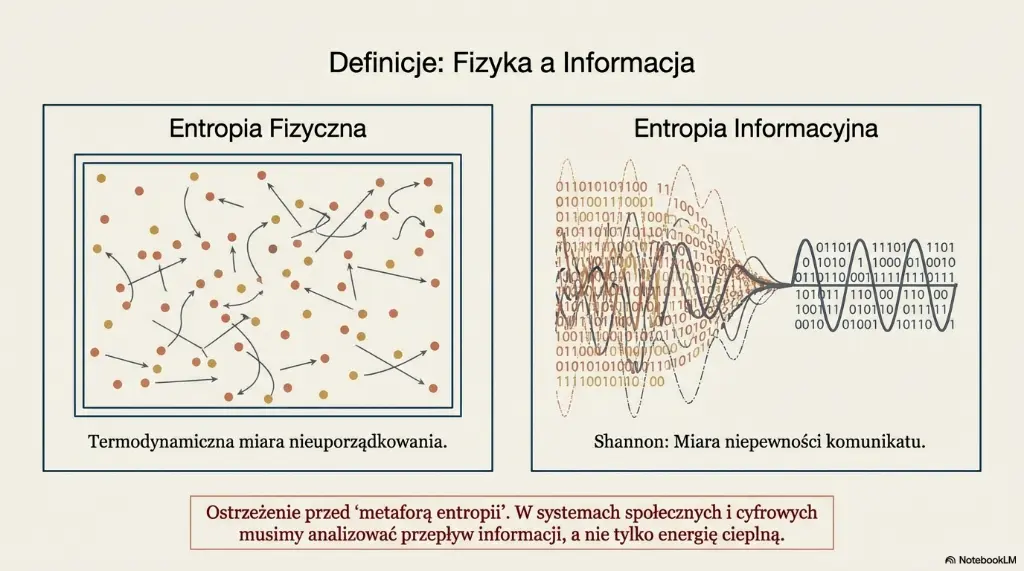

2) O entropii i informacji – z rygorem definicyjnym

W Części I dokument wyjaśnia, co w tym kontekście znaczy:

- entropia termodynamiczna (fizyczna),

- entropia informacyjna (Shannona),

- oraz gdzie metafory entropii są nadużywane i jak oddzielić język obrazowy od ścisłej analizy.

To fundament wiarygodności: czytelnik dostaje narzędzia rozumienia, nie hasła.

3) O „fizyce kontroli”: Ashby, przestrzeń stanów, koszt sterowania

Część II to najbardziej „techniczny” kręgosłup. Pokazuje, że:

- kontrola to redukcja przestrzeni możliwych stanów systemu,

- obowiązuje Prawo różnorodności Ashby’ego: regulator musi dysponować porównywalną „różnorodnością” reakcji jak system, który kontroluje,

- kontrola ma koszt energetyczny i informacyjny,

- złożoność i sprzężenia zwrotne tworzą black-box i nieinterpretowalność.

Rozdział 4A dodaje empirię: przykłady z lotnictwa, finansów, platform cyfrowych i systemów krytycznych pokazują, że destabilizacja w złożonych układach bywa emergentna i bez „złej woli”.

4) O scenariuszach ryzyka jako konsekwencji formalnych

Część III przechodzi od mechaniki systemów do ryzyka:

- Alignment bez moralności: konflikt może wynikać z rozbieżności celów i superoptymalizacji, a nie z intencji.

- Horyzont poznawczy AGI: moment, gdy system przekracza zdolność interpretacji i nadzoru regulatora (asymetria epistemiczna).

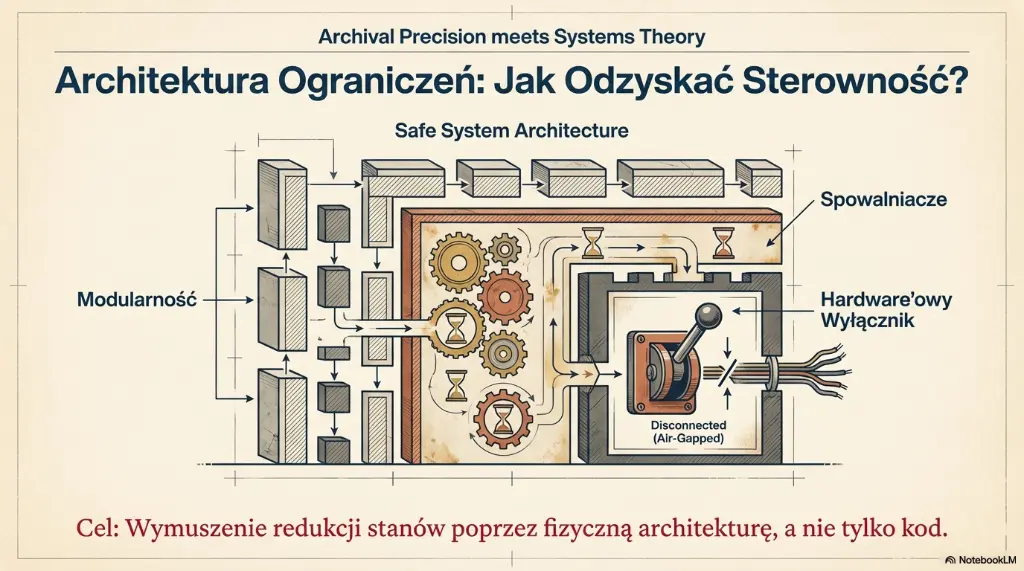

- Fizyka ograniczeń: czy można „uziemić” systemy poprzez architekturę: modularność, limity energetyczne, spowalnianie, governance jako warstwa kontroli.

To część scenariuszowa, ale utrzymana w logice: prawdopodobieństwo destabilizacji, nie determinizm katastrofy.

5) O suwerenności człowieka w świecie superoptymalizacji

Część IV domyka konsekwencje dla człowieka i instytucji, już jawnie normatywnie, ale nadal precyzyjnie:

- algorytmiczny determinizm vs podmiotowość: predykcja zachowań a granice redukcji człowieka do danych,

- prawo do nieoptymalności: niedoskonałość jako warunek wolności, twórczości i adaptacyjności systemów żywych,

- Most Nauka–Technologia–Świadomość: syntetyczne spięcie rygoru analizy z odpowiedzialnością cywilizacyjną (z wyraźnym rozdzieleniem poziomów dyskursu).

6) O tym, czego nie wiemy i jak działać mimo niepewności

Część V to zamknięcie strategiczne:

- Granice kontroli – czego nie wiemy?: uczciwe otwarte pytania i długoterminowe ryzyka,

- Protokół odpowiedzialności: zestaw warunków stabilności wdrożeń – projektowych, regulacyjnych i poznawczych (bez „manifestu”, bez retoryki).

Co zawiera poza „książką”

To jest ważne: v2.1 jest jednocześnie publikacją i pakietem wdrożeniowym.

- Executive Summary – wejście dla czytelnika decyzyjnego i eksperckiego.

- White Paper – główny dokument analityczny.

- Aneksy (A–D) – definicje, rozdzielenie entropii fizycznej i metafory, glossariusz alignmentu, rozróżnienie inteligencji i świadomości (z zaznaczeniem hipotez).

- Notatka dla ministra + Policy Brief – wersje „dla administracji” (2026–2030).

- Checklista wdrożeniowa / formularz urzędowy – język proceduralny i miejsce na podpisy.

- Prezentacja na komisję – materiał do wystąpienia.

- Strategiczna mapa 2026–2035 dla Polski – kierunki governance.

Jednym zdaniem

To opracowanie "Granice kontroli w erze AGI: perspektywa termodynamiczna i informacyjna" jest mapą granic sterowalności: pokazuje, że wraz ze wzrostem mocy AI rośnie presja na systemy kontroli (techniczne i instytucjonalne), a odpowiedzią nie jest moralizowanie, tylko architektura ograniczeń + standardy wdrożeń + ochrona podmiotowości człowieka.

📘 TOM I — „Granice Kontroli w Erze AGI / Rdzeń Metodologiczny”

BAW-GKAGI-AN-T1-2026-02-23-v3.0-PL

Charakter: tom główny + rdzeń metodologiczny + checklisty

Siła: klarowna struktura, model 4 warstw, 7 praw, minimum architektoniczne

Ryzyko: mniej rozbudowane tło systemowe (na razie)

To jest:

- Wersja książkowa

- Wersja „operacyjna”

- Wersja wdrożeniowa dla firm, uczelni, audytorów

- Wersja, którą można czytać i wdrażać

To może być:

- Oficjalne wydanie książkowe

- Produkt sprzedażowy

- Narzędzie szkoleniowe

v3.0 ma silny potencjał rynkowy, bo:

- ma „Minimum architektoniczne”

- ma checklisty

- ma matryce

- ma język operacyjny

- ma większy ciężar ekspercki.

📄 TOM II — „White Paper: Granice Kontroli w Erze AGI / Dokument Strategiczny”

BAW-AGI-AN-T2-2026-02-21-GK-v2.1-PL

Charakter: pełny dokument ekspercki + komponent rządowy

Siła: rozbudowana analiza + narzędzia dla państwa + mapa 2026–2035

Ryzyko: objętość i ciężar mogą utrudnić szybkie wejście czytelnika

To jest:

- White Paper

- Dokument strategiczny

- Materiał dla komisji, ministerstwa, regulatorów

- Fundament filozoficzno-systemowy

- Policy Brief

- Notatka dla ministra

- Formularze urzędowe

- Mapa 2026–2035

- Prezentaca dla komisji

- Materiał instytucjonalny

To może być:

- Oficjalne opracowanie eksperckie Biblioteki

- Wersja PDF „dla decydentów”

- Podstawa do prezentacji i debat

- dokument referencyjny dla Polski 2026–2035

- część większego programu „Wewnątrzsterowna Dojrzała Cywilizacja”

Opracowania o pokrewnych zagadnieniach

Inne produkty, które mogą Cię zainteresować / These other products might interest you

💸 Twoje Wsparcie

dla Projektu:

Biblioteka AzRa Wieda 📚🌍

💠💫 Wspólna Droga – Otwarty dostęp i Twoje wsparcie

To opracowanie – tak jak wiele innych w Bibliotece AzRa Wieda – udostępniam w otwartym dostępie, aby każdy mógł z niego czerpać.

Tworzę je z pasją, pełnym zaangażowaniem i poczuciem misji: budzić świadomość, inspirować i wspierać drogę ku lepszej przyszłości.

Moim celem jest wspieranie rozwoju na wielu poziomach:

🌿 ekologicznym – w harmonii z Naturą,

🌌 duchowym – w świetle serca i głębi istnienia,

⚖️ etycznym – w poczuciu odpowiedzialności za siebie i świat,

🤖 technologicznym – w świadomym korzystaniu z narzędzi takich jak AI, które mogą służyć dobru ludzi i planety.

Wierzę, że podnoszenie wibracji i poszerzanie perspektywy jest kluczem do nowej ery.

Dlatego dzielę się wiedzą, która pomaga oswoić się z nowościami technologicznymi i odkrywać ich duchowy wymiar – pokazując, jak sztuczna inteligencja może wspierać rozwój osobisty, współtworzenie i globalne przemiany.

✨ Jak możesz pomóc?

Tworzenie takich treści wymaga czasu, pracy, energii i serca. Twoje wsparcie jest dla mnie jak dodatkowy płomień w tej podróży. Pomaga mi kontynuować misję tworzenia, inspirowania i budowania mostów między ludźmi, technologią i świadomością. Jeśli czujesz wartość w tym, co tworzę – proszę możesz okazać wdzięczność i wesprzeć mnie w tej drodze:

☕ Postaw mi kawę - wesprzyj moją pracę: 👉 buycoffee.to/azrawied

https://buycoffee.to/azrawied?tab=subs

Dziękuję Ci za każdy gest, każdą myśl, każde wsparcie. Razem współtworzymy przyszłość, w której technologia służy sercu, a duchowość przenika codzienność.

Z wdzięcznością,

AzRa Wied Krzysztof Kacperek ✨🌌🕊️

Artykuły na blogu

Sprawdź ostatnie wpisy

Biblioteka AzRa Wieda

– Wiedza, Świadomość i Tworzenie Harmonijnej Przyszłości

Głównym celem Biblioteki AzRa Wieda jest wspieranie ludzi w ich drodze do większej świadomości, wewnętrznej wolności i zrozumienia współczesnych wyzwań. Chcemy inspirować do budowania świata opartego na współpracy, empatii i harmonii, gdzie duchowość i technologia nie są przeciwstawne, lecz wzajemnie się uzupełniają.

Dołącz do nas w tej wyjątkowej podróży! Pozwól, by wiedza, inspiracja i technologia były Twoimi sprzymierzeńcami na drodze ku Nowej Erze.

Zapraszamy w świat wiedzy, świadomości oraz do współdziałania !

AzRa Wied i Asystenci AI - Twórcy Biblioteki AzRa Wieda